Science goes School Webinar “Deepfakes”

Wie funktionieren „Deepfakes“ – täuschend echte Falschvideos von Personen? Alexander Adrowitzer und Alexander Buchelt gaben spannende Einblicke

Jim Carrey spielt bei Star Trek mit (sogar alle Rollen!) oder Bundespräsident Alexander Van der Bellen singt Reinhard Fendrichs „I am from Austria“. Viele von uns kennen solche täuschend echt aussehenden, aber gefälschten Videos – sogenannte „Deepfakes“.

Aber welche Technik steckt hinter dem Erstellen dieser Videos?

Alexander Adrowitzer, stellvertretender Studiengangsleiter des Bachelor-Studiengangs Data Science and Business Analytics, und Alexander Buchelt, Student im 6. Semester des Studiengangs, erklärten einer Schulklasse der 12. Schulstufe der HAK/HAS Tulln einfach nachvollziehbar die informatischen Schritte, die zum Erstellen eines Deepfakes gehören, und zeigten praktische Beispiele.

Das Webinar fand im Rahmen des „Science goes School“-Programmes der Niederösterreichischen Landesregierung statt.

Webinar mit Teilnehmer*innen der HAK/HAS Tulln | Copyright: HAK/HAS Tulln

Das Prinzip hinter Deep Fakes

Um ein Deepfake zu erzeugen, muss das zur Erstellung benutzte Programm erst einmal aus Fotos oder Videosequenzen der gewünschten Person deren Gesicht analysieren und durch Machine Learning charakteristische Features des Gesichts identifizieren.

Solche charakteristischen Features sind häufig besonders im Bereich der Mundpartie zu finden. In Folge kann das Programm aufgrund dieser Merkmale in weiteren Fotos oder Videos erkennen, ob es sich um die gesuchte Person handelt.

Da die Software nun eine „Formel“ kennt, wie das Gesicht aufgebaut ist, kann sie das Gesicht darauf basierend auch rekonstruieren. Wird diese „Formel“ nun auf den Kopf einer anderen Person angewandt – voilà, schon wurde das gelernte Gesicht auf die andere Person übertragen!

Der singende Bundespräsident und Rechenkapazität

Praktisch gesehen ist heute das Vorhandensein von ausreichendem Bildmaterial, um das Gesicht zu erlernen häufig kein Hindernis am Weg zum Deepfake – gerade von Personen, die in der Öffentlichkeit stehen, liegt mehr als genug Videomaterial vor. Auch die Anwendung der nötigen Schritte ist für Personen mit gewissen informatischen Vorkenntnissen nicht allzu schwer, da bereits fertige Softwarepakete dafür verfügbar sind.

Einzig die Rechenkapazität bremst die Deepfake-Produktion noch etwas, da das Erstellen überzeugender Deepfakes auf handelsüblichen Gaming-PCs von Anfang bis Ende doch noch mehrere Tage dauert. Gaming PCs deshalb, da diese sehr leistungsfähige Grafikkarten eingebaut haben und die Deepfake-Berechnungen besonders effizient auf Grafikprozessoren (GPUs) durchgeführt werden können.

Sind diese genannten Voraussetzungen gegeben, können relativ schnell überzeugende Deep Fakes erzeugt werden. So haben Data Science Studierende der FH innerhalb weniger Tage ein Video von Bundespräsident Alexander Van der Bellen, der „I am from Austria“ singt, erzeugt sowie das Gesicht ihrer Studiengangsleitern Marlies Temper auf den Körper der deutschen Kanzlerin Angela Merkel montiert (siehe Titelfoto).

Ethische Aspekte

Neben dem technischen Prozess wurde im Webinar auch die ethischen und sicherheitsrelevanten Konsequenzen dieser und ähnlicher Technologien mit den Schüler*innen diskutiert. Denn neben nützlichen oder unterhaltsamen Anwendungen (z. B. um Schauspieler*innen in Filmszenen zu „verjüngen“ oder Szenen mit nicht verfügbaren oder verstorbenen Schauspieler*innen zu produzieren), kann die Deepfake-Technik auch benutzt werden, um Falschvideos in betrügerischer oder erpresserischer Absicht zu erstellen.

Die Schüler*innen erkannten die Wichtigkeit, nachzudenken, welches Bildmaterial von sich man im Internet veröffentlicht, da je mehr Material verfügbar ist, umso überzeugendere Deepfakes erzeugt werden konnten.

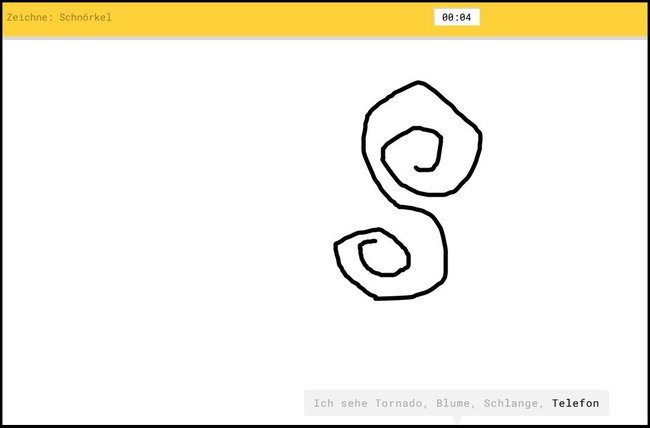

(Ein schönes Beispiel dafür, wie mächtig Machine-Learning-Ansätze zur Bilderkennung sind, wenn sie über sehr viel Trainingsmaterial verfügen, ist die Web-Anwendung „Quick Draw“ – einfach mal ausprobieren!). Die Workshopleitenden machten auch darauf aufmerksam, durch welche Anhaltspunkte sich Deepfakes heute oft noch verraten.

Webanwendung "Quick Draw" erkennt durch Machine Learning Zeichnungen | Copyright: FH St. Pölten

Weiters wurde thematisiert, dass Machine-Learning-Algorithmen wie die für das Erzeugen von Deepfakes eingesetzten Bilderkennungsmethoden, wenn man in deren Anwendung nicht konkret darauf achtet, zu unerwarteter Diskrimination (z. B. rassistische Diskrimination) führen können.

Ein Beispiel dafür ist ein Händetrockner, der auf das Erkennen von Händen trainiert wurde: Da im Bildmaterial für das Training aber nur die Hände von Personen mit weißer Hautfarbe benutzt wurden, konnte das Gerät in Folge nur hellhäutige Hände erkennen und ging bei dunkelhäutigen Personen nicht an.

Die Berücksichtigung dieser ethischen Aspekte und Konsequenzen in der Anwendung von Machine Learning und anderen Big Data-Methoden hat an der FH St. Pölten einen zentralen Stellenwert – so ist zum Beispiel die Lehrveranstaltung „Ethik im Umgang mit Big Data“ fixer Bestandteil des Studienplans für alle Studierenden im Studiengang Data Science and Business Analytics.

Aktionsmonat #ForschenStattFaken

Thematisch fiel die Auseinandersetzung mit dem Phänomen „Deepfake“ in den Aktionsmonat Mai 2021 #ForschenStattFaken des ScienceCenter-Netzwerks, in dem es darum ging, wie Wissenschaftsvermittlung helfen kann, die Fähigkeit zu stärken, zuverlässige von unzuverlässigen Quellen zu unterscheiden und Fakten zu überprüfen.

Die FH St. Pölten beteiligte sich mit mehreren Beiträgen am Aktionsmonat. Wie erfolgreich der Science-goes-School Workshop zum Thema „Fake News“ aufgenommen wurde, zeigt sich daran, dass mittlerweile sogar schon einen Workshop mit einer weiteren Schulklasse stattgefunden hat und weitere Termine für den Herbst bereits in Planung sind (bei Interesse bitte am besten die Webpage mit den Science-goes-School-Angeboten im Auge behalten).

FH-Prof. Dr. Alexander Adrowitzer

Studiengangsleiter Digital Innovation and Research (MA) Stellvertretender Studiengangsleiter Data Science and Artificial Intelligence (BA) FH-Dozent Internationaler Koordinator Department Informatik und Security

Mag. Dr. Angelika Czedik-Eysenberg

WissenschaftsvermittlungForschung und Wissenstransfer Service- und Kompetenzzentrum für Forschung und Kooperation